Ante ”arma de dos filos”, llaman a explorar desafíos normativos y éticos por uso de esta tecnología en el ámbito político; exmagistrado admite peligro de engaño en juicios; se debió anticipar estrategia ante comicios de la dimensión de los de 2024 para garantizar confiabilidad: experto; en Inai ven como reto salvaguardar privacidad

México enfrenta el proceso electoral más extenso en su historia política, inmerso en tecnologías que suponen un riesgo, como la Inteligencia Artificial, sin una estrategia para garantizar la confiabilidad de la renovación de los cargos, incluida la Presidencia de la República.

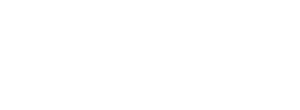

Para la senadora Alejandra Lagunes, del grupo parlamentario del PVEM en la Cámara de Senadores, los usos de la Inteligencia Artificial (IA) rumbo a las elecciones del 2024 en México son “un arma de dos filos” y, aunque se cuestionó si México estaba preparado, hoy confía en que las instituciones puedan enfrentar el desafío que ya inició este mismo 2023.

“La magnitud del tema es inmensa y debemos estar preparados; me gustaría hablar de las elecciones presidenciales de Francia en 2022. Un claro ejemplo del poder y los peligros inherentes al uso de la Inteligencia Artificial en la política. Durante esas elecciones, los ciudadanos franceses fueron testigos del empleo de los deepfakes, de los falsos profundos, una avanzada tecnología de Inteligencia Artificial que permite crear videos falsos, pero altamente realistas mediante técnicas de aprendizaje profundo, lo que podría pasar en cualquier país”, dijo.

Comentó que hoy en día los deepfakes pueden alterar o fabricar contenido audiovisual haciendo que parezca que una persona dice o hace algo que en realidad nunca sucedió y es muy difícil verificarla.

“Es muy difícil saber si es real o es falsa. En uno de los videos más virales se mostraba a Macron insultando a los votantes de Le Pen, un contenido falso creado por hackers utilizando deepfakes para alterar su discurso. Este video, compartido millones de veces, generó una oleada de indignación entre los votantes”, dijo.

La senadora se preguntó cómo impacta la Inteligencia Artificial en la integridad de los procesos electorales y también dijo que es importante saber qué desafíos éticos y morales se enfrentan al incorporar estas tecnologías en el ámbito político.

“Este uso de Inteligencia Artificial debería de estar prohibido o no, debería de ser considerado de alto riesgo o no”, planteó.

Datos del Instituto Nacional Electoral (INE) refieren que en México se contaba con casi 100 millones de ciudadanos inscritos en el padrón electoral el 30 de noviembre del 2023 y más de 97 millones en la lista nominal. Estos números reflejan una participación cívica activa.

Durante el proceso electoral federal del 2024, organizado por el INE, México enfrentará un momento decisivo en su historia democrática, pues se elegirán cargos nacionales y será la elección más grande de la historia de nuestro país.

Este 2023 ChatGPT, herramienta de Inteligencia Artificial generativa, alcanzó 100 millones de usuarios en sólo dos meses, con una inversión de 36 billones de dólares en este tipo de tecnología. Además, dos tercios de las 500 principales compañías en Estados Unidos buscan especialistas en Inteligencia Artificial, según datos proporcionados por la misma senadora del PVEM.

Al referirse al tema, el exmagistrado del Tribunal Electoral de Veracruz Javier Hernández Hernández dijo a La Razón que el proceso electoral que se ha iniciado será histórico y por primera vez los juzgadores se enfrentarán a retos “nunca antes pensados”, como el uso de la Inteligencia Artificial, en medio de la elección más grande que haya vivido México.

“Con el uso de la Inteligencia Artificial, los abogados en materia electoral debemos estar preparados y capacitados porque ya no podemos ver la justicia de manera tradicional. Antes sólo tomábamos en cuenta papel y documentos y ahora hay que hacer uso de las tecnologías de la información”, refirió.

El juzgador admitió que pueden existir “riesgos de ser engañados por información falsa durante el proceso electoral que ya ha iniciado” y agregó que “desde el año 2016, el 95 por ciento, de los casos de estudio que llegaban al Tribunal Electoral tenían que ver con redes sociales y ahora se sumará el caso de la IA”.

La Inteligencia Artificial, al igual que la humana, es un concepto complejo de definir. Aún no existe una definición formal y universalmente aceptada. La Comisión Europea la define como sistemas de software (y posiblemente también de hardware) diseñados por humanos que, ante un objetivo complejo, actúan en la dimensión física o digital.

Para Mónica González Contró, directora del Instituto de Investigaciones Jurídicas (IIJ) de la UNAM, la Inteligencia Artificial “es la nueva frontera del conocimiento, nos brinda beneficios, pero también grandes desafíos que abren una brecha para debatir las implicaciones en relación con los derechos humanos, la desigualdad y el Derecho”.

“El uso generalizado de la IA se debe dar en espacios democráticos, donde esté en medio de la ciudadanía mundial y la educación transformadora, lo que en México estamos en vías de trabajo”, refirió.

El ingeniero en Computación Carlos Leal, quien es egresado de la Universidad Nacional Autónoma de México, dijo a La Razón que “para una elección de tales dimensiones, como la que va a vivir México, se debió establecer una estrategia clara al menos unos tres años atrás, para garantizar confiabilidad, pero no quiere decir que esto sea un impedimento para llevar una elección en orden y transparente”.

“La IA puede comprender y predecir patrones complejos, lo que permite a los líderes políticos tomar decisiones más fundamentadas y efectivas para abordar los desafíos actuales y futuros, pero permite del mismo modo hacer trampas”, explicó.

El especialista recordó el caso de Marcelo Ebrard ocurrido en septiembre, quien fue blanco de críticas por una supuesta declaración creada por IA que lo vinculaba con el bloque opositor, y donde existió uso de esta tecnología.

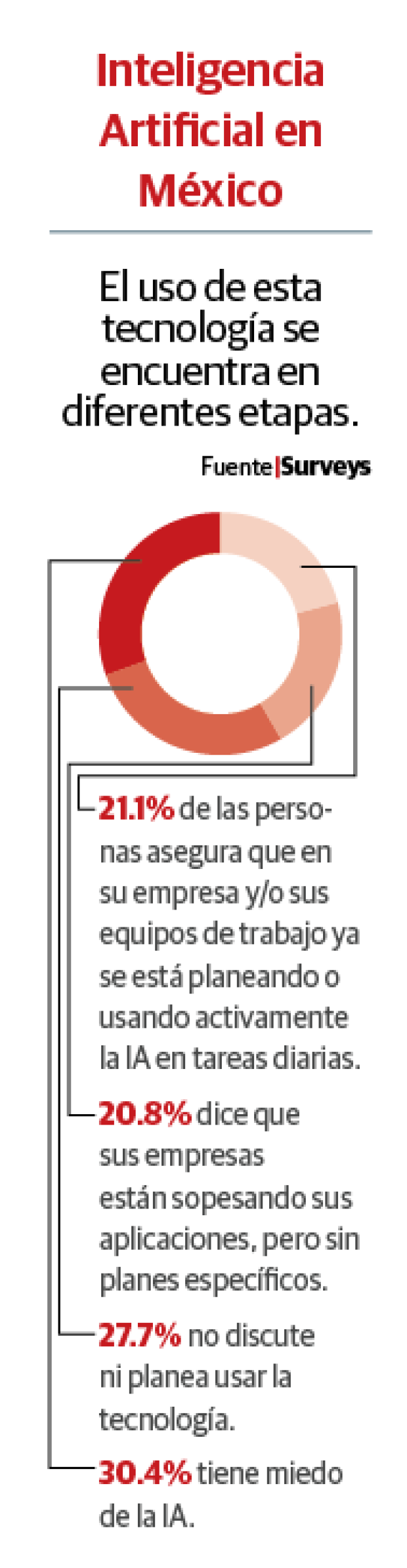

El ingeniero relató que de acuerdo con una encuesta realizada por Surveys en 18 países en abril del 2023, 21.1 por ciento de las personas en México asegura que en su empresa y/o sus equipos de trabajo ya se está planeando o usando activamente la IA en las tareas diarias.

Otro 20.8 por ciento de los mexicanos dice que sus empresas están sopesando sus aplicaciones, pero sin planes específicos; 27.7 por ciento no discute ni planea usar la tecnología, mientras que 30.4 por ciento de los mexicanos “tienen miedo de la Inteligencia Artificial”.

Inai señala riesgos de la IA para la privacidad

El comisionado presidente del Instituto Nacional de Transparencia, Acceso a la Información y Protección de Datos Personales (Inai) , Adrián Alcalá Méndez, planteó que el uso de la Inteligencia Artificial es uno de los principales desafíos en la creación de marcos regulatorios o ambientes de prueba que permitan definir de manera certera los procedimientos de recopilación, almacenamiento y distribución de datos abiertos, así como para salvaguardar la privacidad y seguridad de los datos personales.

Durante su participación en la mesa de diálogo “Sandbox en IA. La gobernanza de datos y privacidad”, Alcalá Méndez explicó que un ejemplo de los ambientes de prueba son los denominados sandboxes, que protegen las partes físicas de los sistemas informáticos, con el fin de evitar daños y ciberataques, generando un entorno seguro para experimentar el potencial de la Inteligencia Artificial.

“En nuestro caso – los sandboxes – representan una oportunidad para fortalecer la transparencia y el aprovechamiento de los datos abiertos justo ahora que acabamos de aprobar, el pasado 9 de octubre, en el Sistema Nacional de Transparencia, la Política Nacional de Datos Abiertos y el 2024 será el año de su implementación”, dijo el comisionado.

“Con los sandboxes, podemos experimentar soluciones innovadoras, con lo cual se contribuye a la construcción de marcos normativos sólidos y que, efectivamente, estén adaptados a la realidad que enfrentamos día con día”, detalló el presidente del Inai.

A su vez, la Senadora Alejandra Lagunes Soto Ruiz, señaló que, ante la relevancia de la Inteligencia Artificial en la actualidad, queda clara la urgencia de debatir sobre el tema de regularla responsablemente, más si tomamos en cuenta que el mundo digital es un reflejo del mundo analógico.

“México es un referente internacional, tiene un marco jurídico sólido en materia de datos, donde se señalan los derechos de titulares, de usuarios, de consumidores, de trabajadores, ante cualquier tecnología que los afecte; y lo más importante, es el compromiso de nuestro país en materia de derechos humanos. Y el Inai, como autoridad autónoma, es la encargada de que se cumplan todas las disposiciones”, apuntó.

En su turno, Roberto Vélez, representante de la embajada de Reino Unido, destacó la necesidad de explorar conjuntamente la visión y el rumbo de la Inteligencia Artificial tanto en México como en Reino Unido conscientes de los riesgos y con la firme intención de fomentar la innovación y el desarrollo tecnológico.

“Agradecemos la apertura para iniciar estos diálogos que, esperamos, nos conduzcan a colaboraciones y a trabajar como aliados en la adopción segura de tecnologías”, apuntó Roberto Vélez.

Sissi De la Peña, de la Academia Mexicana de Ciberseguridad y Derecho Digital, indicó que el sandbox regulatorio para México tiene como objetivo identificar cuáles son los retos y oportunidades que enfrentan el país como distintas organizaciones, para aplicar en la Política Nacional de Datos Abiertos.